可視化#

CNNにおいても可視化は重要である.このノートブックでは,学習と評価が終わったCNN再度読み込み,特徴ベクトルの可視化,フィルタの可視化を行い,学習されたモデルを分析する.

モデルの読み込みとデータセットの準備#

まずは評価データセットに対して特徴ベクトルを計算するために,保存したモデルを再度読み込み,評価データセットを作成する.手順はMLPのときと同様である.

import torch

import torch.nn as nn

class CNN(nn.Module):

def __init__(self, in_channels, num_classes):

super(CNN, self).__init__()

self.conv1 = nn.Conv2d(in_channels, 16, kernel_size=3, stride=1, padding=1)

self.bn1 = nn.BatchNorm2d(16)

self.pool1 = nn.MaxPool2d(kernel_size=2, stride=2)

self.conv2 = nn.Conv2d(16, 32, kernel_size=3, stride=1, padding=1)

self.bn2 = nn.BatchNorm2d(32)

self.pool2 = nn.MaxPool2d(kernel_size=2, stride=2)

self.gap = nn.AdaptiveAvgPool2d(1)

self.flatten = nn.Flatten()

self.fc = nn.Linear(32, num_classes)

def forward(self, x):

x = self.conv1(x)

x = self.bn1(x)

x = nn.functional.relu(x)

x = self.pool1(x)

x = self.conv2(x)

x = self.bn2(x)

x = nn.functional.relu(x)

x = self.pool2(x)

x = self.gap(x)

x = self.flatten(x)

x = self.fc(x)

return x

in_channels = 1

num_classes = 10

model = CNN(in_channels=in_channels, num_classes=num_classes)

save_path = 'output/model.pth'

model.load_state_dict(torch.load(save_path))

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

model.to(device)

CNN(

(conv1): Conv2d(1, 16, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(bn1): BatchNorm2d(16, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(pool1): MaxPool2d(kernel_size=2, stride=2, padding=0, dilation=1, ceil_mode=False)

(conv2): Conv2d(16, 32, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(bn2): BatchNorm2d(32, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

(pool2): MaxPool2d(kernel_size=2, stride=2, padding=0, dilation=1, ceil_mode=False)

(gap): AdaptiveAvgPool2d(output_size=1)

(flatten): Flatten(start_dim=1, end_dim=-1)

(fc): Linear(in_features=32, out_features=10, bias=True)

)

from torch.utils.data import DataLoader

from torchvision import transforms, datasets

transform = transforms.Compose([

transforms.ToTensor(),

])

test_dataset = datasets.MNIST(

root='./data', transform=transform, train=False, download=True)

test_loader = DataLoader(test_dataset, batch_size=100)

注意:

Google Colabで実行している場合,自分のPCに保存したデータをこのノートブックを実行しているセッションへアップロードする必要がある.アップロードはフォルダアイコンをクリックして保存先を表示させて,そこへダウンロードしたファイルをドラックアンドドロップすればよい.また,アップロードした場合,上記の save_path も忘れずに変更しよう.

特徴ベクトルの可視化#

MLPと同様に特徴ベクトルを可視化する.モデルの定義からもわかるように,モデルの出力はロジットである.今回は全ての評価データセットに対してロジットを計算し,保存したいので評価と予測で行ったときと同じように,forループを作成する.

ロジットとそのラベルの保存にはリストを利用する.手間なのでここでロジットをCPUに移動し,numpy形式で保存しておく.

logits, labels = [], []

model.eval()

for batch in test_loader:

x, y = batch

x, y = x.to(device), y.to(device)

with torch.no_grad():

output = model(x)

logits.append(output.cpu().numpy())

labels.append(y.cpu().numpy())

ロジットのリストをnumpy形式に変換する.

import numpy as np

logits_ = np.array(logits)

print(logits_.shape)

(100, 100, 10)

形状を見てもわかるように,(ループ回数,ミニバッチサイズ,出力次元)というテンソルになっている.これを次のように(ループ回数 * ミニバッチサイズ,出力次元)というように(サンプル数,出力次元)という形状に変換する.

logits_ = logits_.reshape(-1, logits_.shape[2])

logits_.shape

(10000, 10)

また正解ラベルについても(ループ回数,ミニバッチサイズ)となっているので(ループ回数*ミニバッチサイズ,)という形状のベクトルへ変換する.

labels_ = np.array(labels).reshape(-1,)

print(labels_.shape)

(10000,)

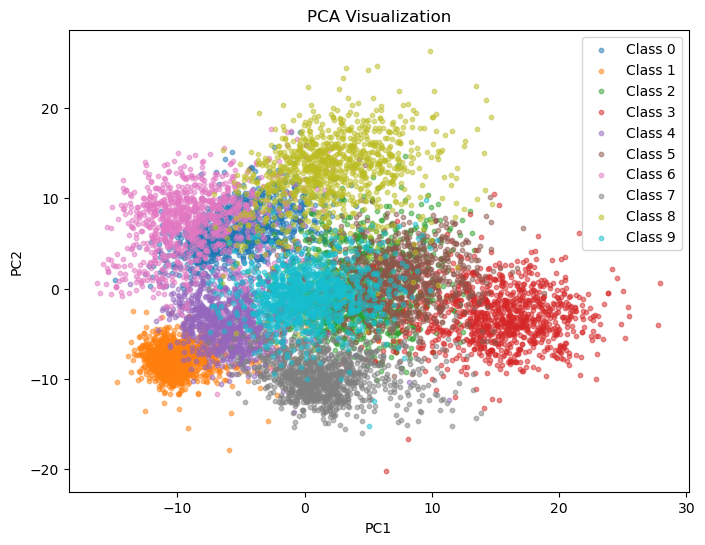

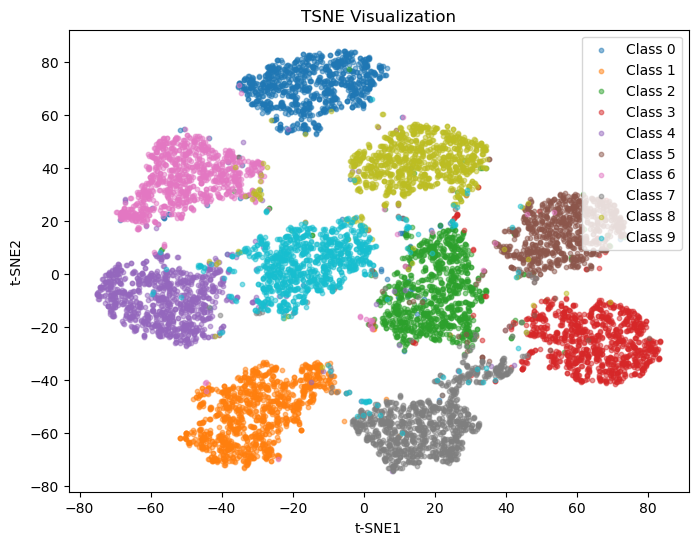

ここで特徴ベクトルの可視化をしたいが,10クラス分類のためロジットの出力次元が10であり,MLPのような2次元での可視化ができない.このような場合,PCA や t-SNE などの次元削減手法を用いて,人間が解釈可能な2次元もしくは3次元空間に変換することが一般的である.これらのアルゴリズムの説明と実装は行わないが,利用するだけなら scikit-learn を用いると非常に簡単に利用できる.

次のセルはPCAによる2次元平面への可視化である.

import matplotlib.pyplot as plt

from sklearn.decomposition import PCA

X = logits_

y = labels_

pca = PCA(n_components=2)

X_ = pca.fit_transform(X)

plt.figure(figsize=(8, 6))

u, counts = np.unique(y, return_counts=True)

for y_ in u:

plt.scatter(

X_[y == y_, 0], X_[y == y_, 1],

s=10, label=f'Class {y_}', alpha=0.5)

plt.title("PCA Visualization")

plt.xlabel("PC1")

plt.ylabel("PC2")

plt.legend()

<matplotlib.legend.Legend at 0x146892beeb80>

次のセルはt-SNEによる2次元平面への可視化である.サンプル数と次元数に応じては数分かかる.

import matplotlib.pyplot as plt

from sklearn.manifold import TSNE

X = logits_

y = labels_

tsne = TSNE(n_components=2)

X_ = tsne.fit_transform(X)

plt.figure(figsize=(8, 6))

u, counts = np.unique(y, return_counts=True)

for y_ in u:

plt.scatter(

X_[y == y_, 0], X_[y == y_, 1],

s=10, label=f'Class {y_}', alpha=0.5)

plt.title("TSNE Visualization")

plt.xlabel("t-SNE1")

plt.ylabel("t-SNE2")

plt.legend()

<matplotlib.legend.Legend at 0x146892062d60>

t-SNEの可視化からもわかるように,クラスごとにクラスタが形成され,分類可能な特徴空間が学習できていることがわかる.今回はロジット空間であったが,MLPやCNNの中間層などでもこのような可視化をすると良い.

しかしながら,これらの可視化を過信するのも良くはない.次元削減ということは,特徴ベクトルが持つ情報が損失しており,またクラスタ間の距離やクラスタの大きさは実際のものとは異なる.これらの手法が示すクラスタや距離はあくまで高次元空間を可視化するための近似的な表現であることに注意されたい.

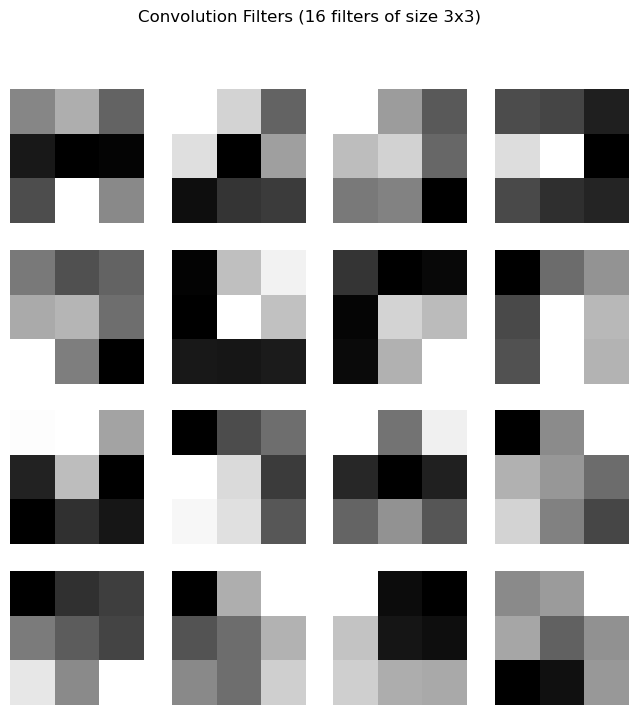

フィルタの可視化#

最初の畳み込み層のフィルタを可視化する.フィルタ(重み)は次のように取得できる.

conv1_filters = model.conv1.weight.data.cpu().numpy()

print(conv1_filters.shape)

print(conv1_filters)

(16, 1, 3, 3)

[[[[-0.01107676 0.10962042 -0.11588892]

[-0.33986473 -0.41163445 -0.3985275 ]

[-0.18056153 0.35302496 -0.00128506]]]

[[[ 0.05210964 -0.02280521 -0.21581845]

[-0.00402427 -0.38602427 -0.11268166]

[-0.3605102 -0.2944681 -0.28378597]]]

[[[ 0.39724973 -0.03790736 -0.3261616 ]

[ 0.10673518 0.20060556 -0.26894194]

[-0.18658875 -0.1488267 -0.72051734]]]

[[[-0.17519288 -0.19847494 -0.31567025]

[ 0.2735009 0.3795438 -0.41360122]

[-0.18231714 -0.266519 -0.30097649]]]

[[[-0.12637481 -0.29984072 -0.21651505]

[ 0.0796133 0.12536715 -0.17323232]

[ 0.43869835 -0.10697041 -0.6358582 ]]]

[[[-0.60389125 0.10668405 0.3016126 ]

[-0.61860156 0.35105786 0.11374085]

[-0.52442133 -0.5330696 -0.5136908 ]]]

[[[-0.30576786 -0.47195822 -0.44644713]

[-0.45496657 0.19498214 0.1183034 ]

[-0.43771833 0.08649515 0.33249697]]]

[[[-0.45389023 -0.11595404 0.00818339]

[-0.22426163 0.34122664 0.119697 ]

[-0.19763888 0.34202126 0.10410086]]]

[[[ 0.274321 0.2816818 0.03467831]

[-0.31734696 0.10330822 -0.40919015]

[-0.40914539 -0.2776413 -0.3488666 ]]]

[[[-0.7746271 -0.46557474 -0.32728767]

[ 0.26075578 0.10941522 -0.5324755 ]

[ 0.22725673 0.13429835 -0.42079404]]]

[[[ 0.35361305 0.17567484 0.33425847]

[ 0.08019698 0.02977923 0.07051321]

[ 0.1568512 0.21531902 0.13887882]]]

[[[-0.97112286 0.01561371 0.8342065 ]

[ 0.2827462 0.09411621 -0.20341441]

[ 0.52369565 -0.05845507 -0.4746079 ]]]

[[[-0.40370354 -0.23344527 -0.1896731 ]

[ 0.02030607 -0.08798312 -0.16785847]

[ 0.3885324 0.06941208 0.47265217]]]

[[[-0.6713055 0.04630457 0.38049117]

[-0.3295831 -0.21945341 0.0622654 ]

[-0.1063465 -0.21781936 0.18318926]]]

[[[ 0.44198215 -0.27157372 -0.30730078]

[ 0.26624563 -0.24391907 -0.26480067]

[ 0.3010637 0.20168476 0.18793127]]]

[[[ 0.06870359 0.13409767 0.51186967]

[ 0.17399944 -0.08075922 0.09705915]

[-0.45031846 -0.38710552 0.12314392]]]]

最初の畳み込み層(conv1)は入力チャネルが1,出力チャネルが16,フィルタサイズが3なので,フィルタの形状が(16, 1, 3, 3) となっている.この畳み込み層には16枚のフィルタがあるのでこれを全て可視化する.

filters = conv1_filters

fig, axes = plt.subplots(4, 4, figsize=(8, 8))

fig.suptitle("Convolution Filters (16 filters of size 3x3)")

for i, ax in enumerate(axes.flat):

filter_2d = filters[i, 0]

img = ax.imshow(filter_2d, cmap='gray')

ax.axis('off')

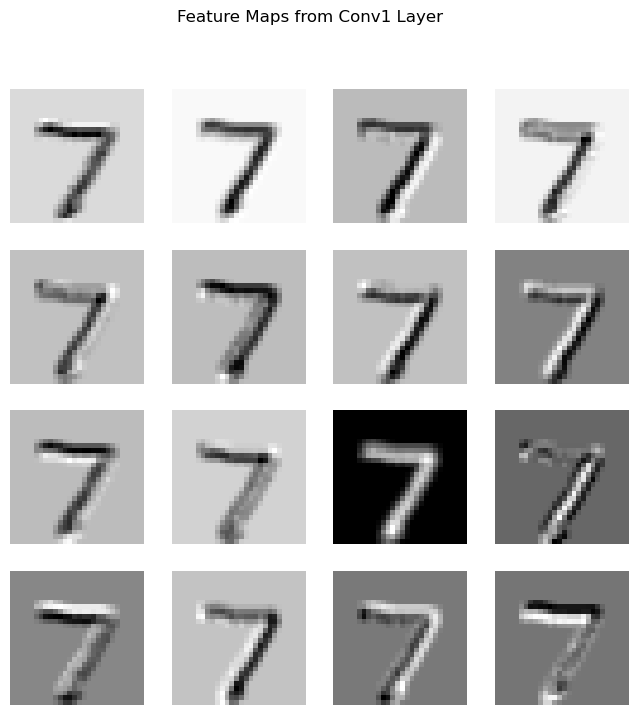

特徴マップの可視化#

入力が画像ということもあり,特徴マップの可視化は重要である.test_datasetから取り出した画像を一枚順伝播したとき,上記で可視化したフィルタを適用するとどのような特徴マップが得られるかを可視化しよう.

中間層で計算される特徴マップを取得するもっとも簡単な方法は output に加えて,その特徴マップを return することであるが,今回はフックというPyTorchの機能を使って取得する.

この機能は次のように register_forward_hook を用いて,指定の層の特徴マップを取得する.

feature_maps = []

def hook_function(module, input, output):

feature_maps.append(output)

model.conv1.register_forward_hook(hook_function)

for batch in test_loader:

x, _ = batch

x = x.to(device)

with torch.no_grad():

_ = model(x)

break

これを実行すると,feature_maps 内に特徴マップが保存される.形状を確認すると,(ミニバッチサイズ,出力チャネル,幅,高さ)である.

feature_maps[0].shape

torch.Size([100, 16, 28, 28])

この特徴マップの最初のサンプルの特徴マップを取得し,フィルタと同様の方法で可視化する.

feature_map = feature_maps[0][0]

fig, axes = plt.subplots(4, 4, figsize=(8, 8))

fig.suptitle("Feature Maps from Conv1 Layer")

for i, ax in enumerate(axes.flat):

feature_map_2d = feature_map[i].cpu().detach().numpy()

ax.imshow(feature_map_2d, cmap='gray')

ax.axis('off')

結果からもわかるように,様々な特徴が強調または抑制された特徴マップが可視化できる.一般的なCNNのモデルはチャネル数も膨大で,Poolingによって低解像度化されるため,入力画像のどこを着目しているかをこれらの可視化から解釈することは難しい.しかしながら,バグチェックも含め,このような可視化は重要であるので必要な場面では確認されたい.

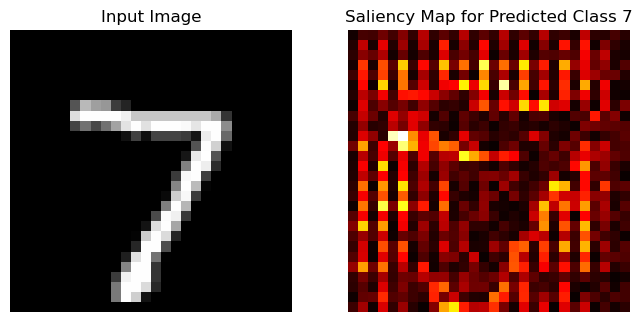

Saliency Map#

Saliency Mapはあるクラスに対応するロジットに対して入力の勾配を計算することで,その値を大きく変化させる画素を可視化する手法である.入力に対する勾配を計算する必要があるので,入力 x に対して,x.requires_grad = True を指定する.そして,予測クラスの特徴次元に対して逆伝播を実行する.得られた勾配の絶対値をmin-max正規化してSaliency Mapとする.

loss_function = nn.CrossEntropyLoss()

for batch in test_loader:

x, y = batch

x, y = x.to(device), y.to(device)

x, y = x[0].unsqueeze(0), y[0]

x.requires_grad = True

model.zero_grad()

output = model(x)

prediction = output.argmax(dim=1).item()

output[0, prediction].backward()

grad = x.grad.data.cpu()

smap = grad.abs().numpy()

smap = (smap - smap.min()) / (smap.max() - smap.min())

break

plt.figure(figsize=(8, 8))

plt.subplot(1, 2, 1)

plt.imshow(x.cpu().detach().numpy().reshape(28, 28), cmap='gray')

plt.title(f'Input Image')

plt.axis('off')

plt.subplot(1, 2, 2)

plt.imshow(smap.squeeze(), cmap='hot')

plt.title(f"Saliency Map for Predicted Class {prediction}")

plt.axis("off")

plt.show()

値が大きい画素は7の予測値を大きく変化させる画素であることを示す.結果からもわかるように,7の形がぼんやりと浮かび上がっていることがわかる.さらに良い可視化を得る手法としてGradCAMがあるので興味がある方は調べることをお勧めする.